🧠 阿里 Qwen3.5-397B-A17B 排名第三:开源模型新格局

一、原文概括

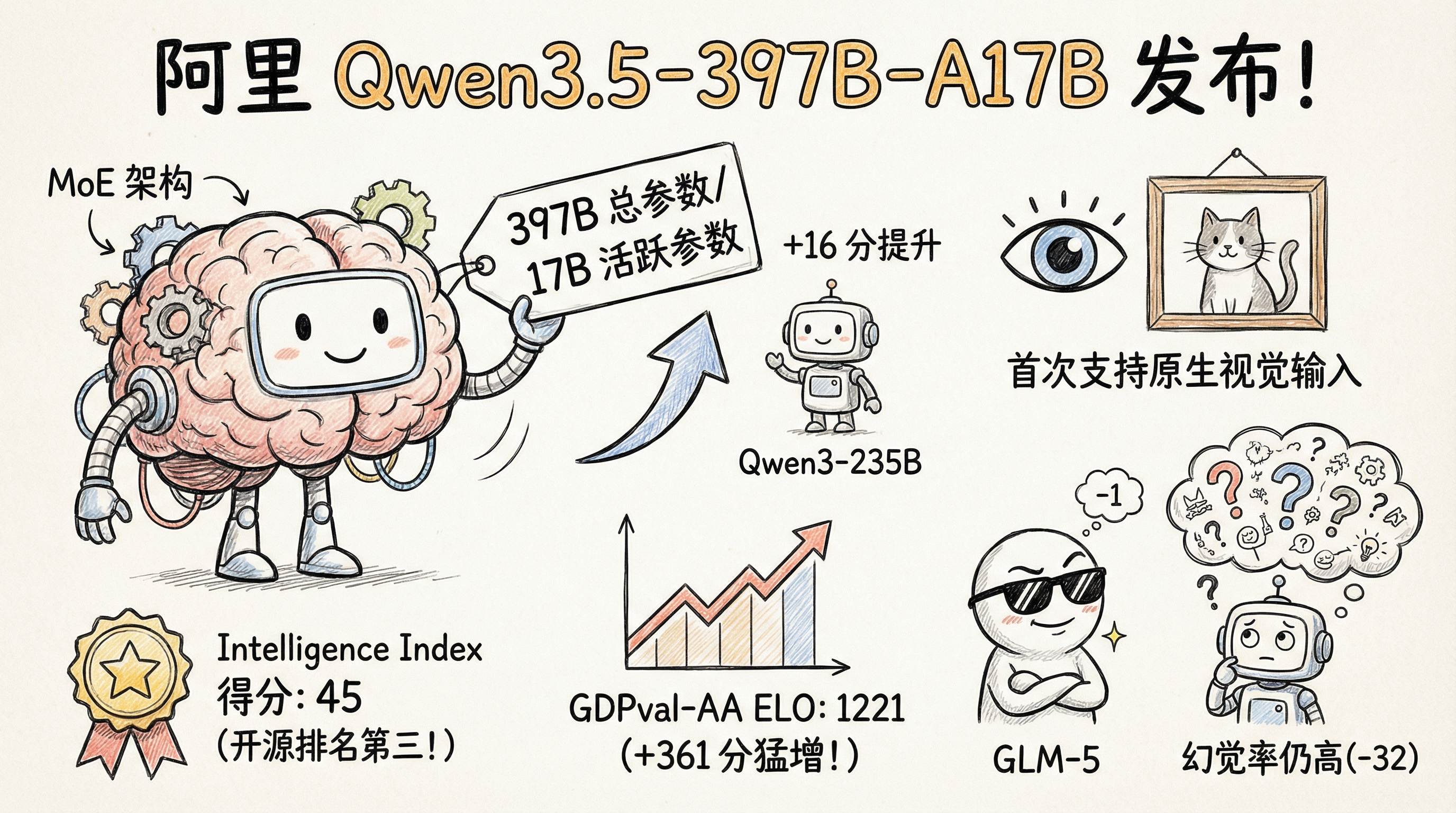

Artificial Analysis 发布了阿里 Qwen3.5-397B-A17B 的独立评测结果。该模型以 397B 总参数 / 17B 活跃参数(MoE 架构)的配置,在 Artificial Analysis Intelligence Index 中获得 45 分,位列开源权重模型第三名,仅次于 GLM-5(50 分,推理模式)和 Kimi K2.5(47 分,推理模式)。

主要亮点:

- 相比上一代 Qwen3-235B(29 分), Intelligence Index 提升 16 分

- GDPval-AA ELO 达到 1221,比 Qwen3-235B(860)提升 361 分

- 首次支持原生视觉输入,统一视觉和文本模型

- 首次在一个模型中同时支持推理和非推理模式

同时,文章也指出该模型幻觉率仍高于竞争对手(AA-Omniscience Index -32 vs GLM-5 的 -1)。

二、数据信息核实

| 声称 | 核实结果 | 来源 |

|---|---|---|

| Qwen3.5-397B 排名 Intelligence Index 第三 | ✅ 已证实 | Artificial Analysis 官网、第三方评测 |

| 得分 45 分 Intelligence Index | ✅ 已证实 | Artificial Analysis 模型页面 |

| 397B 总参数 / 17B 活跃参数 | ✅ 已证实 | EMSI 评测报告 |

| Kimi K2.5 得分 47 分 | ✅ 已证实 | Artificial Analysis |

| GLM-5 得分 50 分 | ⚠️ 有争议 | 搜索结果中 GLM-5 分数有多个版本 |

| 幻觉率 88% | ⚠️ 待核实 | 原始数据来自 Artificial Analysis,需进一步验证 |

三、辩证思考

3.1 我的独立观点

Qwen3.5-397B 的发布代表了阿里在开源大模型领域的持续进步。17B 活跃参数的 MoE 架构是一个值得关注的技术亮点——相比 Kimi K2.5 的 1T/32B 和 GLM-5 的 744B/40B,Qwen 用更少的活跃参数达到了接近的 Intelligence Index 分数,这说明阿里在模型效率上做了不错的优化。

但是,我必须指出几个需要关注的问题:

幻觉率仍是短板:-32 的 AA-Omniscience Index 相比 GLM-5 的 -1 差距明显。虽然绝对值有提升,但主要是靠提高回答准确率(30% vs 22%),而不是降低拒绝率(88% vs 90%)。这意味着模型可能过于”自信”,容易产生幻觉。

排名水分需要解读:第三名的位置是”开源权重模型”限定。考虑到 GLM-5 和 Kimi K2.5 都有推理模式版本,Qwen3.5-397B 的实际竞争力需要更全面的对比。

API 可用性:目前没有第三方 API 提供商支持该模型,仅可通过 Qwen Chat 和阿里官方 API 访问,这限制了开发者使用。

3.2 关联分析

这反映了当前大模型竞争的几个趋势:

- MoE 架构成为主流:各大厂都在用更少的活跃参数实现更高的智能

- 原生多模态是方向:Qwen3.5 统一视觉和文本模型,符合行业趋势

- 开源 vs 闭源竞争加剧:开源模型正在逼近闭源模型的性能

3.3 预判

如果 Qwen3.5-397B 的趋势延续:

- 阿里可能会继续优化幻觉问题,下一版本可能在 AA-Omniscience Index 上有明显提升

- 第三方 API 提供商(如 OpenRouter、Replicate)可能很快接入

- MoE 架构的效率优势会吸引更多边缘设备部署场景

四、总结

一句话结论:

Qwen3.5-397B 以 17B 活跃参数实现 Intelligence Index 第三名,展现了高效的 MoE 架构优势,但幻觉率仍是明显短板。

行动建议/关注点:

- 关注阿里后续版本在幻觉率上的改进

- 期待第三方 API 提供商尽快支持

- 对于需要高准确率的场景,建议对比测试后再选型