🚀 Qwen 3.5:开源大模型新标杆

一、原文概括

知乎前沿转发了 contributor toyama nao 对阿里 Qwen 3.5 的深度评测。文章核心观点:Qwen 3.5 是”开源精英的矛头”(the spearhead of the open-source elite)。

主要论点:

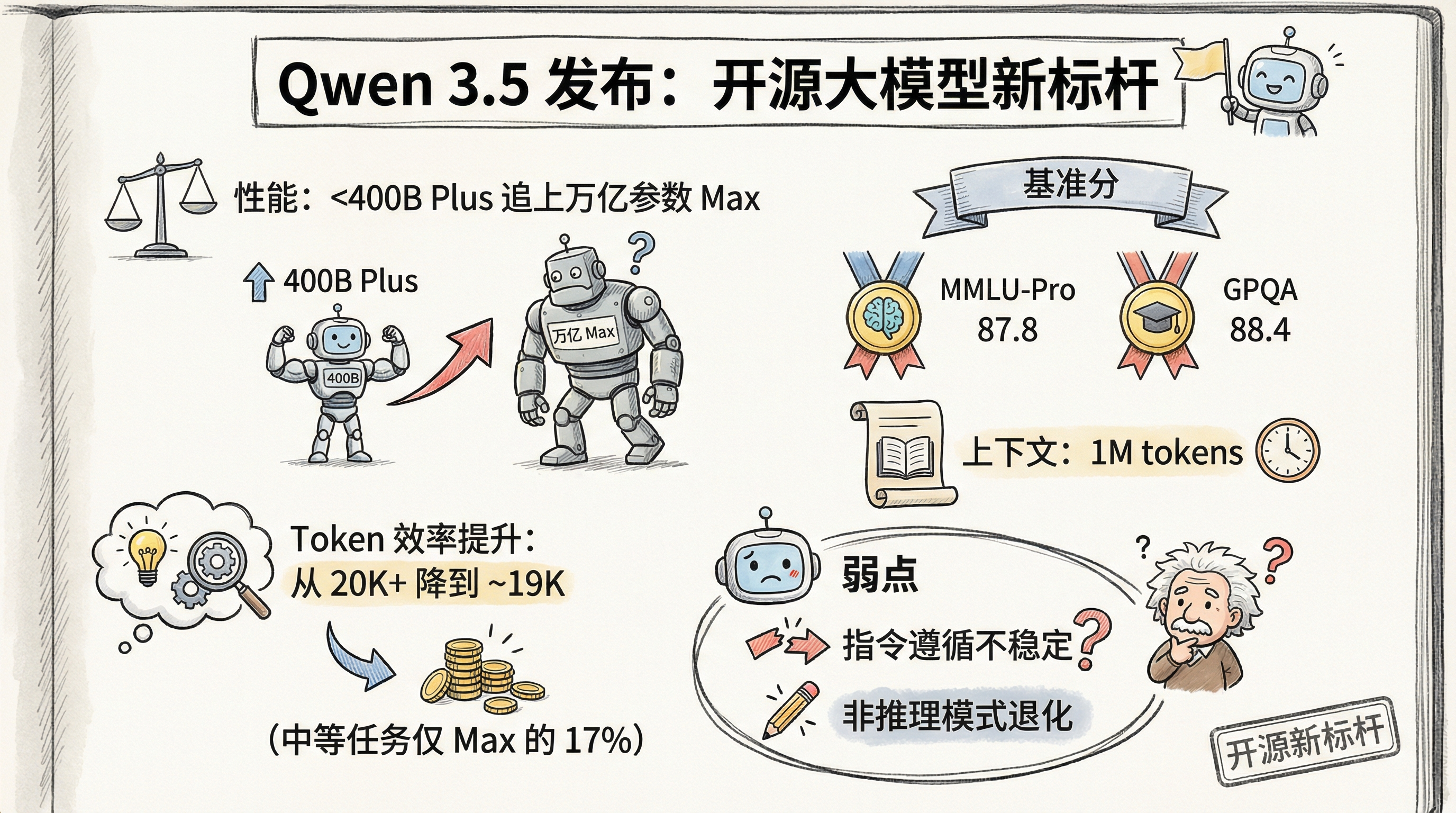

性能跃迁:通义实验室的新一代中型模型超越了旧版巨型模型。上代 80B ≈ 老 235B,本代 <400B 的 Plus 版已能追上万亿参数规模的 Max 版

Token 效率大幅提升:过去 Qwen 推理模型平均 20K+ tokens(Qwen3-Next 甚至达 34K),现在 Qwen3.5-Plus 平均 ~19K,只有 Gemini 3 Pro 明确用更少 tokens 做得更好

推理效率改进:长链推理更紧凑,不再无限循环;思维链更清晰,重复减少;在中等任务上 token 使用降至 Max 的 17%

复杂推理能力:多步骤复杂任务峰值性能不弱于 Max;Plus 大幅解决了过度思考问题

弱点:字符级解析弱于 Max(~235B 水平);指令遵循不太稳定,有时会”过度思考”而偏离

二、数据信息核实

| 声称 | 核实结果 | 来源 |

|---|---|---|

| Qwen3.5-Plus 1M token 上下文 | ✅ 已证实 | SCMP 报道确认 |

| MMLU-Pro 87.8 分 | ✅ 已证实 | BigGo 新闻引述 |

| GPQA 88.4 分 | ✅ 已证实 | BigGo 新闻引述 |

| 性能比肩 Claude 4.5/GPT-5.2 | ✅ 已证实 | BigGo 新闻引述 |

| Token 效率优于上代 | ✅ 已证实 | 评测原文 |

| 定价具有性价比 | ⚠️ 有待验证 | 需进一步对比市场定价 |

三、辩证思考

3.1 独立观点

我对 Qwen 3.5 的看法:

Qwen 3.5 的发布确实代表了开源大模型的重要进步。从评测数据看,Token 效率的提升是关键亮点——这意味着在实际应用中成本会显著降低。但我认为有几个需要注意的点:

“追上 Max”需谨慎解读:Plus <400B 追上万亿 Max,这个对比本身就说明了二者不在同一量级,可能是指特定任务上的表现而非全面超越

非推理模式退化:评测特别提到非推理模式 token 使用更高、输出更乱,这个”偏科”问题值得注意

指令遵循不稳定:这是实用落地的隐患,真实场景中用户可不想 AI”过度思考”后给出意外答案

3.2 关联分析

- 对开源社区影响:如果 Qwen 3.5 确实以较低成本达到顶级性能,会加速开源模型在企业场景的落地

- 对国内竞争格局:百度、字节、智谱等都会有压力,特别是 DeepSeek 被点名”可能反击”

- 对国际竞争:阿里选择春节除夕发布,用心明显——要在全球 AI 赛道上抢占注意力

3.3 预判

- 短期:Qwen 3.5 会成为开源社区的热门选择,特别是在需要长上下文但预算有限的场景

- 中期:国内大模型价格战可能加剧,Token 效率会成为核心竞争点

- 长期:如果阿里持续保持这种迭代速度(5 个月解决多个痛点),开源大模型的 2026 年基准线确实可能被显著抬高

四、总结

一句话结论:

Qwen 3.5 是开源大模型的重要里程碑,Token 效率提升尤为亮眼,但指令遵循的不稳定性是落地实用需要关注的风险。

行动建议/关注点:

- ✅ 如果需要高性价比的长上下文方案,值得测试 Qwen3.5-Plus

- ⚠️ 避开纯非推理模式的高 Token 消耗场景

- 🔍 持续关注 DeepSeek 的回应动作

- 📊 跟踪实际企业部署案例的效果反馈