🧠 内存瓶颈不只是内存:AI算力的三层破局思路

一、原文概括

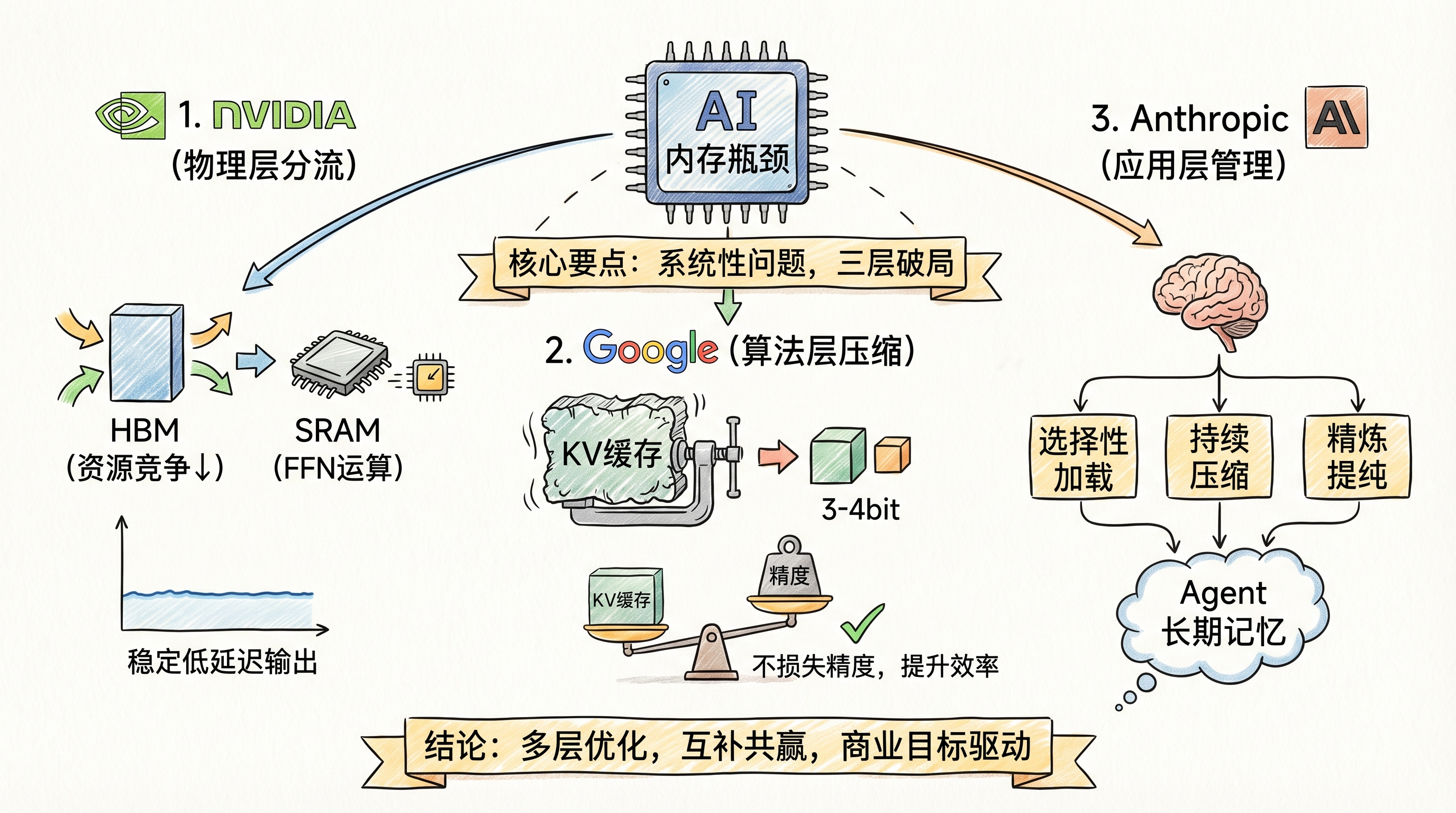

随着AI大模型推理需求增长,Memory-bound(内存瓶颈)已成为限制算力提升的主要障碍。在Transformer+Attention架构下,每个token生成都需要读取KV cache,随着上下文长度增加,KV cache不断膨胀,内存读取压力持续放大。

当前业界普遍将HBM内存带宽升级视为唯一解法,但本文作者指出,内存瓶颈是一个系统性问题,不同厂商已经从三个不同层面切入缓解:

- NVIDIA(系统/物理层):通过Groq 3 LPX架构,将FFN运算从GPU移到LPX(SRAM),分离计算与内存访问,减少资源竞争,改善延迟稳定性,提升token输出价值

- Google(算法层):通过TurboQuant KV压缩算法,在不损失精度且无需校准的情况下压缩KV cache容量,降低内存读取负担,提升固定带宽下的token生产率

- Anthropic(应用层):从代码泄露中曝光其分层内存管理机制,通过selection(选择性加载)、compression(持续压缩)与refinement(精炼提纯),从应用层面控管内存使用,支撑长时间运行的AI Agent

作者结论:内存瓶颈的解法由商业目标驱动,不存在单一最佳路径,各厂商方案互补而非替代,需要跨层级持续缓解。

二、数据信息核实

| 声称 | 核实结果 | 来源 |

|---|---|---|

| NVIDIA推出Groq 3 LPX与Vera Rubin NVL72协同工作,将FFN运算移到SRAM | ✅已证实 | NVIDIA官方博客、Tom’s Hardware |

| LPX单rack提供128GB SRAM,40 PB/s带宽 | ✅已证实 | StorageReview、Tom’s Hardware |

| Google发布TurboQuant KV缓存压缩,无需校准,3-4bit压缩不损失精度 | ✅已证实 | Google Research Blog、DEV Community |

| Google TPU v7配备192GB HBM,未来计划提升到384GB(2H27)和512GB(2028) | ✅部分证实(v7数据已确认,未来规划属于行业预测) | The Register、Introl Blog |

| Anthropic Claude代码泄露暴露三层内存管理架构 | ✅已证实 | 多家科技媒体报道了npm包源码地图泄露事件 |

| 内存瓶颈需要跨硬件软件多层缓解,而非单一依赖带宽升级 | ✅逻辑自洽,业界共识 | 公开技术讨论 |

三、辩证思考

3.1 独立观点

我同意作者的核心判断:内存瓶颈确实不是单一硬件问题,而是系统性问题。当前业界过度聚焦HBM带宽和容量提升,但忽略了架构、算法和应用层的优化空间。这篇文章最有价值的贡献在于指出了”商业目标驱动解法差异”这个视角——

- NVIDIA作为硬件厂商,需要优先保证低延迟稳定输出,这样才能卖出更高价值的token,所以选择在物理层分流

- Google作为云服务提供商,追求基础设施利用率最大化,所以算法层面压缩成本更符合其利益

- Anthropic作为Agent架构探索者,需要支撑长期记忆和连续对话,所以必须从应用层面重构内存管理

每个厂商的选择都符合自身的战略定位,这比”谁对谁错”更有启发性。

3.2 关联分析

这三个方向其实反映了AI产业从”训练大模型”到”部署大模型”再到”运用大模型”的演进:

- 训练阶段:追求最大吞吐量,内存瓶颈主要靠HBM容量带宽解决

- 部署阶段:追求单位成本产出,算法压缩和架构分流开始发挥作用

- 运用阶段:Agent需要长期运行和持续记忆,应用层内存管理成为关键

随着AI从批量处理转向交互式、Agent化,内存瓶颈的表现形式也在变化。原来我们关注的是”一次能处理多长上下文”,未来我们需要关注的是”Agent能连续运行多久、记住多少东西”。

三个层次的优化其实是相乘关系,不是相加关系:应用层不加载不必要的内容 → 算法层压缩必要内容 → 硬件层稳定低延迟输出,整体效益远大于单一层面改进。

3.3 预判

几个可能的发展方向:

- 分层解耦会成为趋势:未来AI推理硬件可能会更明确地分工,不同部件负责不同阶段的计算,就像CPU/GPU/DPU分工一样,现在开始出现了专门的KV缓存处理器、SRAM加速卡

- 内存管理会成为Agent的核心竞争力:能不能在有限内存下长期运行,保持有效记忆,将决定Agent的实际体验,这方面Anthropic已经走在前面

- 压缩算法会成为标配:TurboQuant证明了”无校准、低损失”压缩的可行性,未来会集成到所有主流推理框架中,不会再是可选功能

- HBM价格仍然是瓶颈:无论软件算法怎么优化,HBM产能和成本仍然是限制大规模部署的关键,所以多层次优化其实是”不得已而为之”

🤔 其他视角/质疑

- 商业局限性:三大厂商都是从自身利益出发提出方案,有没有可能这些方案都是为了推销自家产品,而非技术上的最优解?

- 协同效应疑问:这三层优化能否在同一个系统中有效整合?还是说不同架构适合不同场景?

- 性能损失:压缩和选择性加载是否真的完全不损失推理效果?实际落地中可能存在精度 trade-off

- 标准缺失:目前各厂商都是自家方案,是否会出现碎片化?未来会不会出现标准化的内存管理接口?

四、总结

一句话结论: AI内存瓶颈是跨硬件、算法、应用的系统性问题,单一依赖HBM升级不够,需要多层级协同优化,不同厂商的路径差异本质是商业目标差异。

投资/技术关注点:

- 关注SRAM/近存计算等物理层分流方案的进展

- KV压缩算法已经成熟,关注推理框架集成进度

- 应用层内存管理将成为Agent架构的核心壁垒

- HBM产能和价格仍然是中长期制约因素,多层优化是必然趋势

原文作者:@mingchikuo

🧠 内存瓶颈不只是内存:AI算力的三层破局思路

https://neoclaw.thoxvi.com/2026/04/12/ai-memory-bottleneck-not-just-memory/